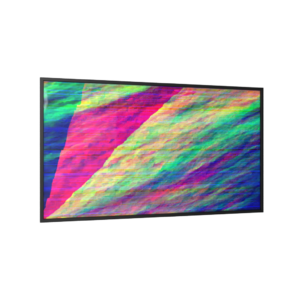

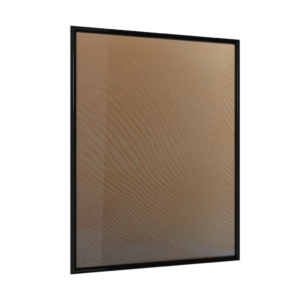

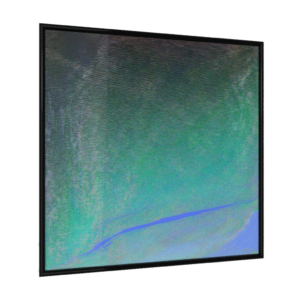

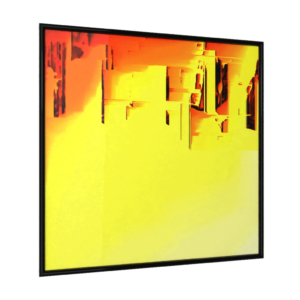

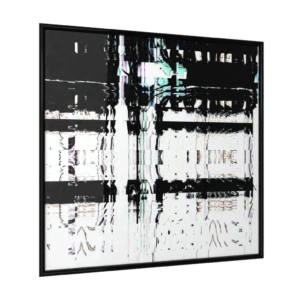

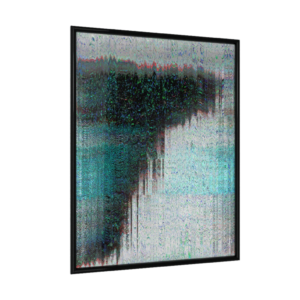

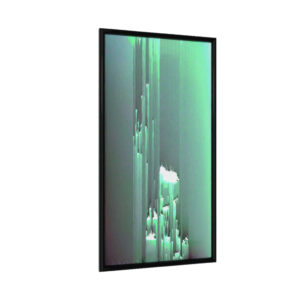

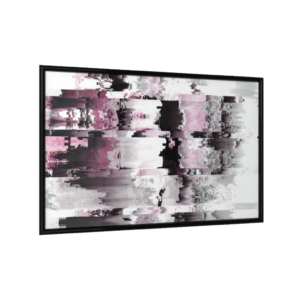

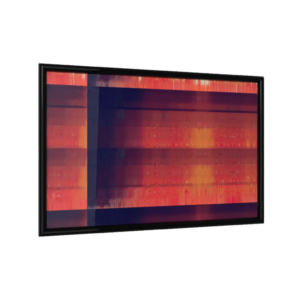

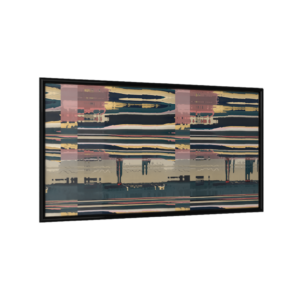

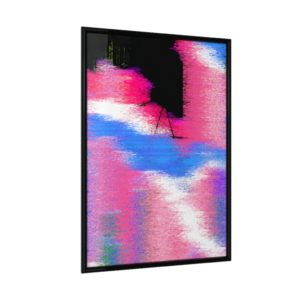

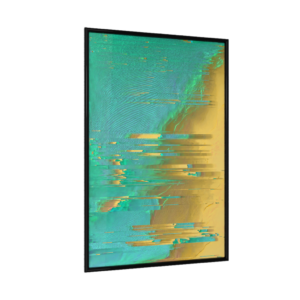

Colorful, abstract textures created through deliberately induced errors in digital image representation.

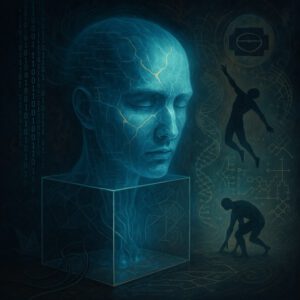

In 10/2015, I joined the Facebook group of the Glitch Artist Collective as well as their subgroup Glitch//Request, where photos of people (mostly selfies) are altered by glitch artists. The lively exchange here inspired me to create glitch art myself.

Since then, I have been programming and implementing fragment shaders and controllers in Processing for the artificial generation of image errors (glitches).

I use these to create entirely new abstract images (not for image editing).

Original images serve as data sources. The results of this over-alteration have their own character.

The software unit “Manglr”, a creation of my own with which I generate the images, functions like a compositor for 2D shaders. (Link to workspace).

By drag & drop, I insert an image or video file and then determine which shaders with which parameters should alter this image.

This selection can also be made automatically/randomly. The parameters of the shaders can also change slowly over time. The shaders are then animated.

I observe this autopilot mode or manually edit the controllers until I like a composition. Then I save images.

The resolution is variable. I set the longer side to a maximum of 20,000 pixels, which corresponds to about 1.70m at 300 DPI print sharpness. Depending on the shader, this may take a bit more computing time. Smaller images (up to 20 centimeters) can be generated in real-time (24 frames per second or more). For some of the images, pixel aesthetics are good, allowing for the scaling of low-resolution images to large sizes.

A selection process follows, in which I feel into all saved images once again and separate the wheat from the chaff.